AI安全之对抗样本攻击

概念

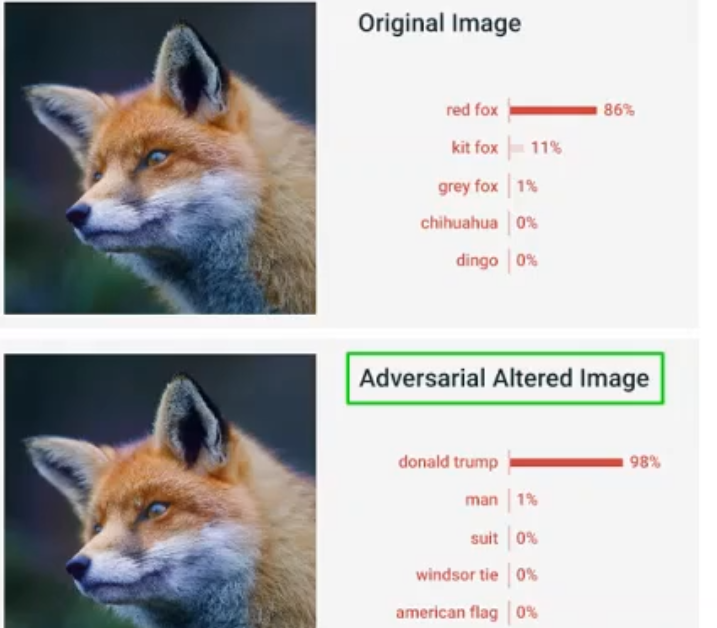

对抗样本,就是对输入数据进行略微修改,以使得机器学习算法对该输入给出错误的分类结果。在很多情况下,这些修改非常细微,人类观察者甚至根本不会注意到这些修改,但是分类器却会因此犯错误。对抗样本攻击对目前的机器学习系统提出了挑战,因为即使攻击者无法访问基础模型,也能对机器学习系统发起攻击。

ADVBOX对抗样本工具箱

下载地址:https://github.com/advboxes/ADVBOX

该工具支持多种攻击方法,包括白盒、黑盒

可以用来生成对抗样本

白盒攻击(White-box attack methods)

- L-BFGS

- FOSM

- BIM

- ILCM

- MI-FGSM

- JSMA

- DeepFool

- C/W

黑盒攻击(Black-box attack methods)

- Single Pixel Attack

- Local Search Attack

防御方法(Defense methods)

- Feature Squeezing

- Spatial Smoothing

- Lable Smoothing

- Gaussian Augmentation